本文介绍一种简洁优雅的多标准中文分词方案,可联合多个不同标准的语料库训练单个模型,同时输出多标准的分词结果。通过不同语料库之间的迁移学习提升模型的性能,在10个语料库上的联合试验结果优于绝大部分单独训练的模型。模型参数和超参数全部共享,复杂度不随语料库种类增长。

线性模型

机器学习——线性模型

广义线性模型(Generalized Linear Models)

线性回归

均方误差最小化算法

基于均方误差最小化来进行模型求解的方法称为“最小二乘法(least square method)”。在线性回归中,最小二乘法就是试图找到一条直线,使所有样本到直线上的欧式距离之和最小。

岭回归

岭回归(英文名:ridge regression, Tikhonov regularization)是一种专用于共线性数据分析的有偏估计回归方法,实质上是一种改良的最小二乘估计法,通过放弃最小二乘法的无偏性,以损失部分信息、降低精度为代价获得回归系数更为符合实际、更可靠的回归方法,对病态数据的拟合要强于最小二乘法。

正则化算法

逻辑回归(Logistic Regression)

多元逻辑回归(Softmax Regression)

结构化机器学习项目——机器学习策略(2)

结构化机器学习项目——机器学习策略(1)

改善深层神经网络——超参数调试、Batch正则化和程序框架

改善深层神经网络——优化算法

改善深层神经网络——深度学习的实用层面

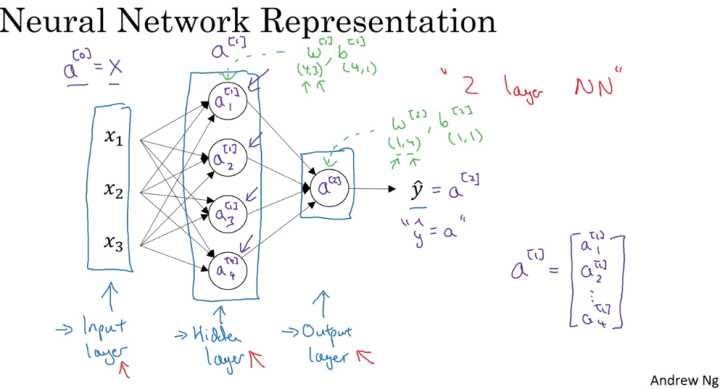

DeepLearning.ai学习笔记

学习的东西一段时间不使用总归是需要回顾一下的,学而时习之嘛!更何况毕竟不再年轻-_-!在学习DeepLearning.ai的过程中,将自己认为较为核心的东西记录下来,以便之后进行复习。